攻撃者による生成 AI利用への関心が高まる。一方で、その利用は依然として限定的

遅くとも 2019 年以降、Mandiant は、サイバー攻撃の脅威者がさまざまな悪意のある活動を実行するための AI 機能に関心を示し、使用していることを追跡してきました。私たち自身の観察とオープンソースの情報に基づくと、侵入活動における AI の採用は依然として限定的であり、その多くはソーシャル エンジニアリングに関連していることがわかっています。

対照的に、さまざまな動機と能力を持つ情報操作活動の攻撃者は、AI が生成したコンテンツ、特に画像やビデオを作戦に活用しており、その利用は拡大しています。これはおそらく、偽情報活動におけるそのような捏造の応用が、比較的容易であると考えられることに起因していると考えることができます。さらに、昨年複数の生成 AI ツールがリリースされたことにより、これらの機能の持つ影響力に対する関心が再び高まっています。

生成 AI ツールにより、脅威アクターによる情報操作や侵入活動への AI の組み込みが加速すると予想されます。 Mandiant は、このようなテクノロジーは将来的に悪意のある攻撃活動を大幅に増強する可能性があり、Metasploit や Cobalt Strike などのエクスプロイト フレームワークによってもたらされる利点と同様に、限られたリソースと能力で攻撃活動を行えるようにする可能性があると判断しています。しかし、攻撃者はすでに実験を行っており、時間の経過とともに情報操作における AI ツールの使用が増えることが予想される一方で、実際の運用上の効果的な使用は依然として限られています。

リアリティの補強:情報操作活動における生成AIの活用

Mandiant は、生成 AI テクノロジーには、2 つの重要な側面において情報操作行為を行う攻撃者の能力を大幅に強化する可能性があると判断しています。すなわち、攻撃者が元々備えている能力を超えて活動を効率的に拡大する能力と、事実を欺く目的でリアルな捏造コンテンツを作成する能力です。

生成 AI により、情報操作を行う攻撃者が持つリソースや能力が限定的だったとしても、より高品質のコンテンツを大規模に作成できるようになります。

- モデルは、特定のシナリオに沿った記事や政治漫画などのコンテンツを作成したり、真偽不明のペルソナを支援するための無害なつなぎコンテンツを作成したりするために使用されます。

- 大規模言語モデル (LLM) に基づく会話型 AI チャットボットからの出力により、外国語の聴衆をターゲットとする攻撃者が以前直面していた言語の壁が軽減される可能性があります。

AI によって生成された非常にリアルなコンテンツは、AI テクノロジーの恩恵を受けずに作成されたコンテンツよりも、ターゲットとなる聴衆に対してより強い説得力を持つ可能性があります。

- 私たちは以前、脅威アクターが望ましいシナリオの流布を支援するために、捏造されたコンテンツを投稿することを観察しました。たとえば、 ロシアの「ハクティビスト」グループ CyberBerkut は、さまざまな組織による悪意のある活動を明らかにする通話録音を漏洩したと主張しました。実際の個人の声でトレーニングされた AI モデルを使用すると、扇動的なコンテンツや虚偽の公共サービスのアナウンスなど、同様の音声の捏造が可能になる可能性があります。

情報操作を行う攻撃者による生成 AI テクノロジーの適用

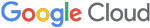

Mandiantは、情報操作を行う攻撃者による生成 AI の導入は、公的に利用可能なツールの可用性と機能、感情的な反応を引き起こす各メディア形式の有効性などの要因により、テキスト、画像、音声、ビデオなどのメディア形式によって異なると予想しています。 (図1)。私たちは、AI によって生成された画像とビデオが近い将来に使用される可能性が最も高いと考えています。また、LLM を使用した運用はまだ観察されていませんが、LLM の潜在的なアプリケーションが急速な普及につながる可能性があると予想しています。

AIによって生成された画像

現在の画像生成機能は、敵対的生成ネットワーク (GAN) とテキスト-to-画像生成モデルという 2 つのカテゴリに大別できます。

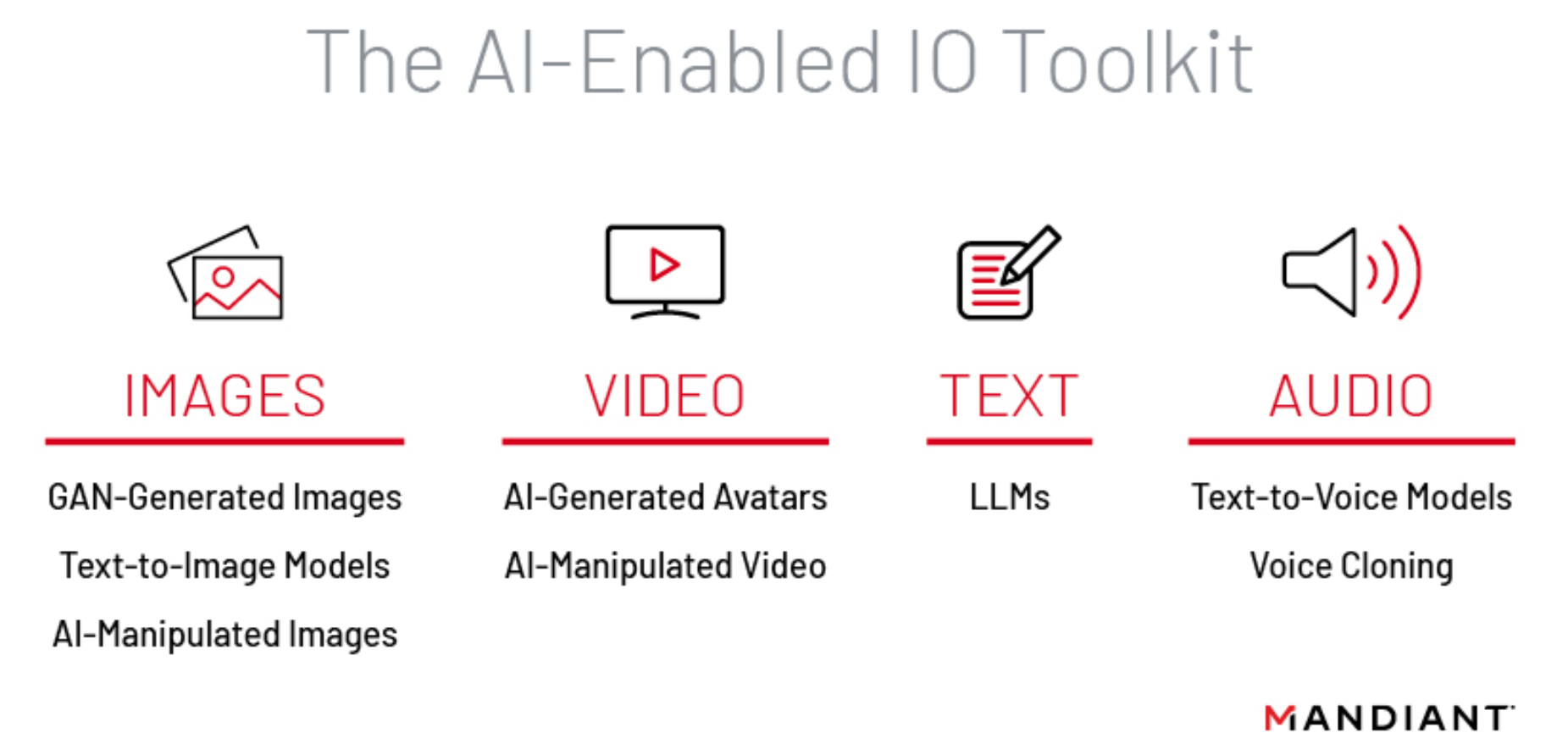

- GAN は人間の被験者のリアルな顔写真を生成します。

- テキスト-to-画像の生成モデルは、テキスト プロンプトに基づいてカスタマイズされた画像を作成します。

2019年以降、Mandiantは、ロシア、中華人民共和国(PRC)、イラン、エチオピア、インドネシア、キューバ、アルゼンチン、メキシコ、エクアドル、エルサルバドルなどの国家と連携する攻撃者や、4chanフォーラムの個人のような非国家アクターなどによる、偽のペルソナのプロフィール写真に使用される典型的なGANを活用した情報操作の事例を多数確認しています。私たちは、Webサイト thispersondoesnotexist.com のようなGANで生成された画像ツールが一般に公開されていることが、情報操作に頻繁に利用される一因になっている可能性が高いと判断しています(図2)。また、攻撃者はAIが生成したプロフィール写真の出所をわかりにくくするために、フィルターを追加したり顔の特徴をレタッチするなどの工夫をしています。

テキスト-to-画像モデルを活用した同様の活動はそれほど多く観察されていませんが、最近公開されたツールや技術の向上により、時間の経過とともにその使用が増加すると予想されます。

テキスト-to-画像モデルはまた、GAN よりも重大な偽情報の脅威をもたらす可能性があります。

- テキスト-to-画像モデルは、より広範なユースケースに適用できます。 GAN は主にペルソナの構築を支援するために使用されていることが観察されていますが、テキスト-to-画像モデルは、さまざまなシナリオや捏造をサポートするためにより広範囲に使用される可能性があります。

- テキスト-to-画像モデルによって生成されたコンテンツは、GAN によって生成されたコンテンツに比べて検出が難しい可能性があります。人が技術を使って手作業で検知する、あるいはAI 検知モデルを使う場合のいずれにおいてもです。

私たちは、テキスト-to-画像モデルを介して偽情報が拡散することをさまざまな例で観察してきました。親中DRAGONBRIDGE情報操作キャンペーンもそのうちの一つです。

- 2023年3月、DRAGONBRIDGEは米国の指導者を否定的に描写するシナリオをサポートするため、複数のAI生成画像を利用しました(図3)。DRAGONBRIDGEが使用したこのような画像は、もともとジャーナリストのエリオット・ヒギンズが作成したもので、彼はツイートで画像の生成にMidjourneyを使用したと述べており、このツールの潜在的な使用法を示すために使用したと示唆しています。

- 他のDRAGONBRIDGEの活動と同様、これらのメッセージは大きな関心を集めることはありませんでした。

- 2023年5月、ロシアの国営メディア「RT」や、ブルームバーグ・メディア・グループのアカウントを装った認証済みアカウント「@BloombergFeed」などのツイッターアカウントが、米国防総省ペンタゴン付近での爆発を描いたとされるAI生成画像を共有したことで、米国の株価が一時的に下落しました。

AI によって生成および操作されたビデオ

公開されている AI 生成および AI 操作ビデオ テクノロジは、現在主に次の形式で構成されています

- カスタマイズ可能な AI が生成した人間のアバターが音声をテキストに変換して朗読するビデオ テンプレート。ニュース放送などのプレゼンテーション形式のメディアをサポートするためによく使用されます。

- 顔入れ替えツールなどの AI 対応ビデオ操作ツール。既存のビデオの顔に個人の顔を重ね合わせます。

2021年以降、Mandiantここで詳述されているようなケースを含め、このような技術を活用して望ましいシナリオを拡散しようとする情報操作活動を観察してきました。個人のなりすましなど、他の形式の AI 生成ビデオ テクノロジーが向上するにつれて、それらの活用がさらに進むことが予想されます

- 2023年5月、MandiantはDRAGONBRIDGEが短いニュースセグメント形式のビデオでAIが生成した「ニュースプレゼンター」を使用していることを顧客に報告しました。この動画は、AI企業のD-IDが提供するセルフサービス・プラットフォームを使って作成された可能性が高いと評価しています(図4)。

- 2022年、ソーシャルメディア分析会社のGraphikaは、DRAGONBRIDGEがAIが生成したプレゼンターを別の動画生成サービスSynthesiaで制作したと別途報告しており、このキャンペーンが少なくとも2つのAI動画生成サービスを利用していたことを示唆しています。

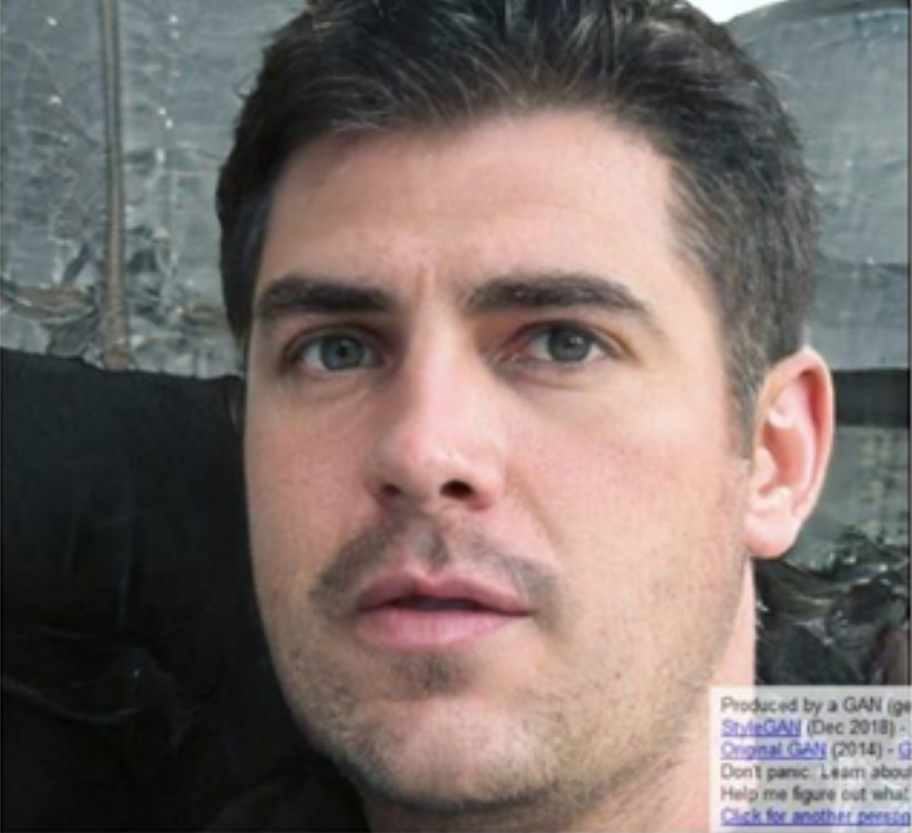

- 2022年3月、ロシアによるウクライナ侵攻の後、情報操作作戦は、ウクライナ大統領ヴォロディーミル・ゼレンスキーのディープフェイク動画を含む様々な手段を通じて、ウクライナがロシアに屈服したとする捏造メッセージを宣伝しましたた(図5)。

- 2021年6月、ベラルーシにつながるGhostwriterキャンペーンの関連Telegramアセットが、AIによって操作された政治家の映像を映画のビデオクリップに重ねたり、歌を歌っているかのように操作したビデオクリップを公開しました。これらの投稿の少なくとも1つには、"Reface Appで作られた "ことを示す透かしが入っていました。

- 2021年4月、Mandiantは、ソーシャルメディアのアカウントが、AI技術を活用してメキシコの知事候補の顔を映画のシーンに挿入し、彼が麻薬を使用しているように見せかけるビデオを宣伝する情報操作を確認しました。

AI によって生成されたテキスト

Mandiant はこれまでのところ、AI 生成テキストまたは LLM を参照している情報操作の事例を 1 件しか観察していませんが、最近の一般にアクセス可能なツールの出現とその使いやすさにより、それらの急速な普及につながる可能性があると予想しています。

- 2023年2月、DRAGONBRIDGEのアカウントは、OpenAIが開発した会話型チャットボットであるChatGPTが中国と米国に二重基準を適用していると非難し、チャットボットが中国が自国領土上空で米国の民間用気球を含む民間航空機を撃墜することを禁止すると述べたとされるやり取りを引用しました。

AIによって生成された音声

Mandiantはこれまで、協調的な情報操作活動において AI 生成の音声がほとんど使用されていないことを観察してきましたが、4chan などの技術のユーザーが、暴力的、人種差別的、トランスフォビア的な発言をしているように見える著名人の音声トラックを作成していることを観察しています。 AI によって生成されたオーディオ ツールは何年も前から存在しており、テキストから音声へのモデルや音声の複製、なりすましなどの機能を備えています。テキストから音声への生成も、AI 生成ビデオ ソフトウェアの重要な機能を構成します

ソーシャルエンジニアリングの強化

偵察

Mandiantは以前、攻撃者がAIベースのツールを使用してさまざまな活動を支援したり、これらのアプリケーションを使用してオープンソース情報や、偵察および標的選定のためにすでに盗まれたデータの処理を支援したりするさまざまな方法を紹介しました。

- 国家が支援する諜報機関は、大量の窃取データやオープンソースデータに機械学習やデータサイエンスツールを適用することで、データ処理や分析を改善し、スパイ行為者が収集した情報をより迅速かつ効率的に運用できるようにすることができます。また、これらのツールは、従来のスパイ活動で情報収集のために外国人を特定したり、効果的なソーシャル・エンジニアリング・キャンペーンを作成したりする技術を向上させるためのパターンを特定することもできます。

- Black Hat USA 2016において、研究者たちはSNAP_R(Social Network Automated Phishing with Reconnaissance system)と呼ばれるAIツールを発表しました。このツールは、価値の高い標的を示唆し、ユーザーの過去のTwitterアクティビティを分析して、ユーザーの古いツイートに基づいてパーソナライズされたフィッシングコンテンツを生成します(図6参照)。

- Mandiantは以前、脅威アクターがニューラルネットワークを活用して、情報操作のための不正なコンテンツを生成できることを明らかにしました。

- Mandiantは、北朝鮮のサイバースパイ攻撃グループである APT43 がLLMに関心を示していることを特定しました。Mandiantは、同グループが広く利用可能なLLMツールにログオンしていることを示唆する証拠を観察しており、彼らが潜在的にLLMを活用して活動を行っている可能性がありますが、その目的は不明です。

- Black Hat USA 2023において、セキュリティ研究者は、LLMに統合されたプロンプト・インジェクション攻撃が、攻撃ライフサイクルのさまざまな段階をサポートする可能性があることを指摘しました。

ルアーコンテンツ

攻撃者は標的の言語を理解する能力に関係なく、LLMを使用することで、標的に合わせたより説得力のあるルアーコンテンツを作成することができます。LLMは、悪意のある攻撃者が人間の自然な会話パターンを反映したテキスト出力を作成するのに役立ち、フィッシング・キャンペーンや初期侵入を成功させるためのより効果的な素材を作ることができます。

- オープンソースの報告によると、攻撃者は生成AIを使用して効果的なルアーコンテンツを作成して侵害の成功率を高めている可能性があり、LLMを使用して既存の操作に使用される言語の複雑性を高めている可能性があります。

- Mandiantは、操作されたビデオや音声コンテンツをビジネスメール詐欺(BEC)で使用する金銭的動機の攻撃者、Know Your Customer(KYC)要件を破るために操作された画像を使用する北朝鮮のサイバースパイ攻撃者、イスラエル兵をターゲットにしたソーシャルエンジニアリングで使用される音声変換技術の証拠を指摘しています。

- メディアの報道によると、金銭的な動機に基づく攻撃者は、生成AIツール「WormGPT」を開発し、攻撃者がより説得力のあるBECメッセージを作成できるようにしたとしています。さらに、攻撃者はこのツールによって、カスタマイズ可能なマルウェア・コードを記述することができます。

- 2023年3月、複数のメディアが、人工知能(AI)が生成した音声を使った何者かが、交通事故で外交官を殺害したとされる息子とその代理弁護士になりすまし、カナダ人夫婦が2万1000ドルを騙し取られた事例があったと報じました。

- さらにMandiantは、金銭目的の攻撃者が、ディープフェイク技術サービスを含むAI機能をアンダーグラウンドフォーラムで宣伝するのを観測しています。ディープフェイク機能を活用することで、ソーシャルエンジニアリング、詐欺、恐喝などの活動をより自然にパーソナライズして、これらサイバー犯罪活動の効果を高めるとしています。

マルウェアの開発

Mandiant は、脅威アクターがマルウェア開発をサポートするために LLM を使用する機会が増えると予想しています。 LLM は、攻撃者の技術的熟練度や言語の流暢さに関係なく、攻撃者が新しいマルウェアを作成したり、既存のマルウェアを改良したりするのに役立ちます。メディアの報道によれば、LLMはマルウェアの生成に欠点があり、修正には人間の介入を必要とする可能性があるとのことですが、マルウェアの作成を大幅に支援するこれらのツールの能力は、熟練したマルウェア開発者を補

- オープンソースの報告によると、金銭的な動機に基づく攻撃者は、マルウェアの開発や増殖、およびルアーコンテンツの生成へのLLM使用を防ぐために設計されたLLMの制限を回避するサービスを、アンダーグラウンドフォーラムで宣伝しています。

- Mandiantは、2023年1月から3月にかけて、LLMのサービス、販売、APIアクセス、およびLLMによって生成されたコードを宣伝する脅威アクターをアンダーグラウンドフォーラムで確認しました。

- あるユーザーは、LLMの安全機能をバイパスして、ある特定のエンドポイント検知・対応(EDR)ソリューションの防御を回避できるマルウェアを書き込ませると主張する動画をアップロードしました。このユーザーは、2023年2月下旬にバグ報奨金プログラムにこの件を提出し、支払いを受けました。

展望と影響

脅威当事者は、絶えず変化するサイバー脅威の状況の一部として、新しいテクノロジーを活用し、それに対応しながら、定期的に戦術を進化させています。Mandiantは、このようなテクノロジーを取り巻く認識と能力が発展するにつれて、多様な起源と動機を持つ脅威アクターが生成AIをますます活用するようになると予測しています。例えば、何が本物で何が偽物かを区別できない一般大衆を悪意ある行為者がうまく利用し続けることが予想され、生成AIがより流動的な現実をもたらす中で、個人も企業も同様に、取得する情報に対してより慎重になる必要があります。ただし、脅威アクターがこのテクノロジーに関心を寄せているのは確かではあるものの、その採用は今のところ限定的であり、短期的にはこの状況が続くかもしれません。

NOTE: 脅威アクターによる生成AIの利用はまだ始まったばかりですが、セキュリティ・コミュニティには、生成AIの採用などの防御の強化によって脅威アクターを凌駕し、セキュリティ担当者やユーザーに利益をもたらすための機会が与えられています。Mandiantの防御担当者がどのように日々の業務で生成AIを使用し、脅威をより早く特定し、労力を軽減し、これらのワークフロー全体のスピードとスキルを向上させる人材関連のタスクをよりよく解決しているかについては、こちらをご覧ください。

Googleは、AIの文脈における誤報や偽情報に対処するポリシーを製品およびサービス全体で採用しています。AIシステムのセキュリティ確保に関する詳しい情報は、Google SAIFをご覧ください。Google SAIFは、成長し続けるAI技術を共同で保護するための概念的フレームワークです。Googleがソフトウェア開発に適用しているセキュリティのベストプラクティスにヒントを得たSAIFは、AIシステムに特化した検出と対応、制御の適応、防御の自動化などに関するガイダンスを実務者に提供します。

※本ブログは、8月17日に公開されたブログ「Threat Actors are Interested in Generative AI, but Use Remains Limited」の日本語抄訳版です。